ebet真人ChatGPT每年电费2亿!日耗电量≈17万个家庭 网友:挺值!在谷歌搜索中应用生成式AI技术,谷歌每年的耗电量将高达290亿千瓦时,也就是每天约7900万度(?)。

作者是荷兰数字经济学家Alex de Vries,他通过英伟达、OpenAI、谷歌等公开数据进行估算。

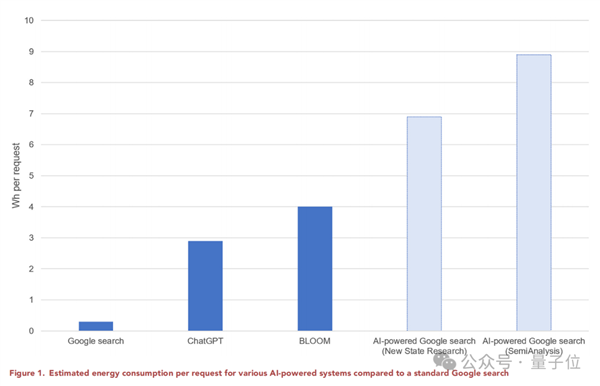

ChatGPT每天需要响应1.95亿次请求,预计每天需要消耗564兆瓦时电力,每个请求大约2.9瓦时。

但这也与模型再训练频率、模型性能与功耗之间的平衡有关系。比如BLOOM在推理阶段的耗电量就显著降低。

如果要将大模型能力植入到谷歌搜索中,预计需要512821个HGX A100,按照每台设备功耗为6.5千瓦来计算,每天将需要80吉瓦时的电力消耗,一年需要29.2太瓦时。

目前谷歌每天需要处理高达90亿次搜索,换算一下,平均每个请求要消耗6.9-8.9瓦时,已经是普通搜索的20倍+。

去年第二季度,英伟达收入创纪录,其中数据中心部门较上季度相比增长了141%,这表示AI方面的需求扩增。

今年,英伟达AI服务器出货量可能达到150万台,总功耗可能达到9.75-15.3吉瓦。这一数量级的服务器,每年的用电量将达到85.4-134太瓦时。

哪怕像谷歌这样在全球拥有数十亿用户的厂商,也会慎重考虑AI与搜索引擎的融合。硬件、软件和电力成本压力下,厂商脚步或许没那么快。

硬件生产本身还受到掣肘,AI热潮使得台积电CoWoS先进封装产能吃紧ebet真人,但新建工厂真正可能开始批量生产要等到2027年,这或许也会影响英伟达的出货量。

短期内,在各种资源因素影响下ebet真人,AI用电量增速会被抑制;但硬件和软件的能效提高,显然也无法抵消长期的电力需求增长。

总之,作者认为在AI开发方面,还是不要铺张浪费的好。监管机构也需要考虑要求厂商披露相关数据,提高整个AI供应链的透明度,从而更好了解这一新兴技术的环境成本。

因为AI超算数据中心需要大量水来散热,微软也承认用水是训练模型的一大成本,从2021年到2022年,其全球用水量飙升了34%,相比研究AIGC前急剧增加。

一天50万度电,1.7万个美国家庭。但美国有1.2亿个家庭ebet真人,也就是只需万分之一的家庭用电,就能支撑一个服务全球TOP 1的AI产品、服务几亿用户,这还是在浪费能源破坏环境吗?

话又说回来,尽管比起收益,ChatGPT一日1.7万个家庭的能耗还不值一提,但AI能耗确实也是一个值得关注的问题。

随着技术越来越成熟,AI将消耗越来越大量的电力,如果能源技术无法突破,就无法实现这一目标(即让AI技术释放全部潜力)。

说起可控核聚变,奥特曼其实早就押注了一家相关公司,名叫Helion。

据了解,Helion成立于2013年,目前约150+员工。他们预计将在2028年上线兆瓦规模的可控核聚变发电项目,微软将率先采购。